生成式人工智能AI大战,“AI芯片需求大爆发”丨Chat GPT带动半导体需求…… 行业正在期待!

生成式人工智能AI大战,“AI芯片需求大爆发”

ChatGPT和Midjourney等生成性人工智能服务产品正在吸引市场的关注。在此背景下,韩国人工智能产业协会(KAIIA)在首尔三成洞的COEX举行了 "2023年Gen-AI峰会"。为期两天的活动旨在促进和推动生成性人工智能的发展,而生成性人工智能正在扩大整个市场。

第一天,从人工智能融合事业部负责人金俊河的主题演讲开始,微软、谷歌和AWS等积极开发和服务ChatGPT的大型科技公司,以及开发人工智能半导体的无晶圆厂行业出席并做了相关演讲,包括Persona AI首席执行官Yoo Seung-jae的 "ChatGPT带来的NLP变化",以及Furiosa AI首席执行官Baek Jun-ho的 "为ChatGPT构建高性能、高能效和可扩展人工智能推理芯片"。

金俊河表示在2023年,即人工智能战争之年,ChatGPT插头将作为谷歌和MS之间巨大语言模型竞争的新游戏规则进入市场。在这种情况下,他预计人工智能半导体和支持人工智能模型的加速器将有机会。

Furiosa AI是韩国国内代表性的制造 AI 半导体的无晶圆厂公司。正在努力开发通用 AI 半导体以赶上在超大规模 AI 领域占据全球大部分市场的 Nvidia 的 Furiosa AI CEO Baek 坚信,“未来 AI 领域对芯片的需求将呈爆炸式增长”

随着人工智能服务变得越来越复杂,它们不可避免地面临着基础设施成本增加的问题。英伟达目前的A100和H100 GPU产品具有人工智能计算所需的高性能和计算能力,但由于总成本的增加,如高功耗和部署成本,即使是超大规模的企业在转向下一代产品时也对成本效益比表示担忧。

对此,Baek预测了技术发展的方向,他说除了越来越多的公司采用人工智能解决方案外,市场需求将是在一个特定的系统内实现效率和性能的最大化,比如 "节能"。

此外,他强调,人工智能半导体在国内发展的传播点是'可用性',并表示如何解决开发环境支持和'可编程性'将是关键。

Nvidia已经建立了CUDA来展示其支持生态系统,而确保支持TensorFlow和Pytoch等深度学习代表性框架的开发社区正在成为产品化的重要生存策略。

Chat GPT带动半导体需求…… 行业正在期待!

Nvidia GPU 受益于 ChatGPT…… AMD也不断发布服务器芯片。“GPT4万亿参数,大内存容量、高速度、低功耗要求”

在世界各地对ChatGPT兴趣日益浓厚的情况下,半导体行业也预测ChatGPT将拉动对半导体的需求,以生成式AI和大规模AI模型为主导的市场正在爆发。

世界各地对 ChatGPT 的兴趣正在迅速上升。在两个月内全球用户达到 1 亿的 ChatGPT 证实,在基于国内标准的 Naver 搜索趋势中,与 12 月相比,“Chat GPT”或“Chatgpt”的搜索量分别增加了 8,428% 和 1,424% . 在全球范围内,ChatGPT 的谷歌搜索量达到 100,是 2 月份的最高数字,并且与去年 11 月的 0-2 相比表现出明显更高的兴趣。

■ ChatGPT商业化预计投入30,000个GPU

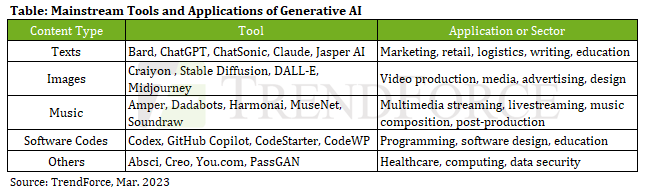

▲ 生成式人工智能的关键工具和应用领域(来源:Trendforce)

根据市场研究机构TrendForce的数据,随着ChatGPT商业化的准备,基于Nvidia的A100 GPU,预计GPU需求将达到30,000个。

TrendForce提到,2020年ChatGPT模型开发使用的学习参数数量增加到1800亿个,处理训练数据所需的GPU数量约为2万个。

因此,随着生成式人工智能成为趋势,对GPU的需求显着增加,预计将增加相关供应链公司的利润。尤其是,Nvidia 受到市场的关注最多,因为根据 ChatGPT 的票房预期,它也有望从 AI 开发中受益最多。

AI 工作负载 NVIDIA DGX A100 Tensor Core 80GB 提供 5 PetaFlops(每秒 5,000 万亿次运算)的性能,并提供大数据分析和 AI 加速的选项。此外,AMD 还针对服务器市场推出了基于 AI 的应用 Instinct MI100-300 系列,而 CEO Lisa Su 在最近的 CES 主题演讲中提到了 ChatGPT,并表示,“通过将训练时间从几个月缩短到几周,数百万它可以节省美元能源。”

TrendForce断言,台积电将在相关供应链中作为先进计算芯片的主要代工厂发挥关键作用。目前,台积电是英伟达芯片生产的主要工厂,在先进节点和小芯片封装方面具有强大的地位。此外,预计对 ABF(Ajinomoto Build-up Film)基板的新需求以及 AI 芯片开发商的收益。

Eugene Investment & Securities 研究中心负责人 Lee Seung-woo 在半导体发展战略论坛上评估了 ChatGPT,并预测“根据人工智能服务的扩展程度,对计算和服务器扩展的需求将增加”,但分析说重要的是用户数量的增加。

他说,“世界排名第一的超级计算机 Frontir 的计算速度为 1.1 exaflops(每秒 110 quintillion 2,000 万亿次运算),学习 GPT-3 大约需要 3.5 天。”大约是 2 美分。例如,如果 3000 万人平均每天问 10 个问题,则将发生 3 亿笔交易,这将需要每天 600 万美元(约 80 亿韩元)的计算成本。

Lee 主任补充说,“AI 学习本身并不是增加需求的大变量。”他补充说,“重要的不是学习,而是由于用户数量增加而带来的流量,这可能会导致对芯片的需求增加,例如作为服务器扩展和模型构建。”

■ ChatGPT4,需要内存超缩放

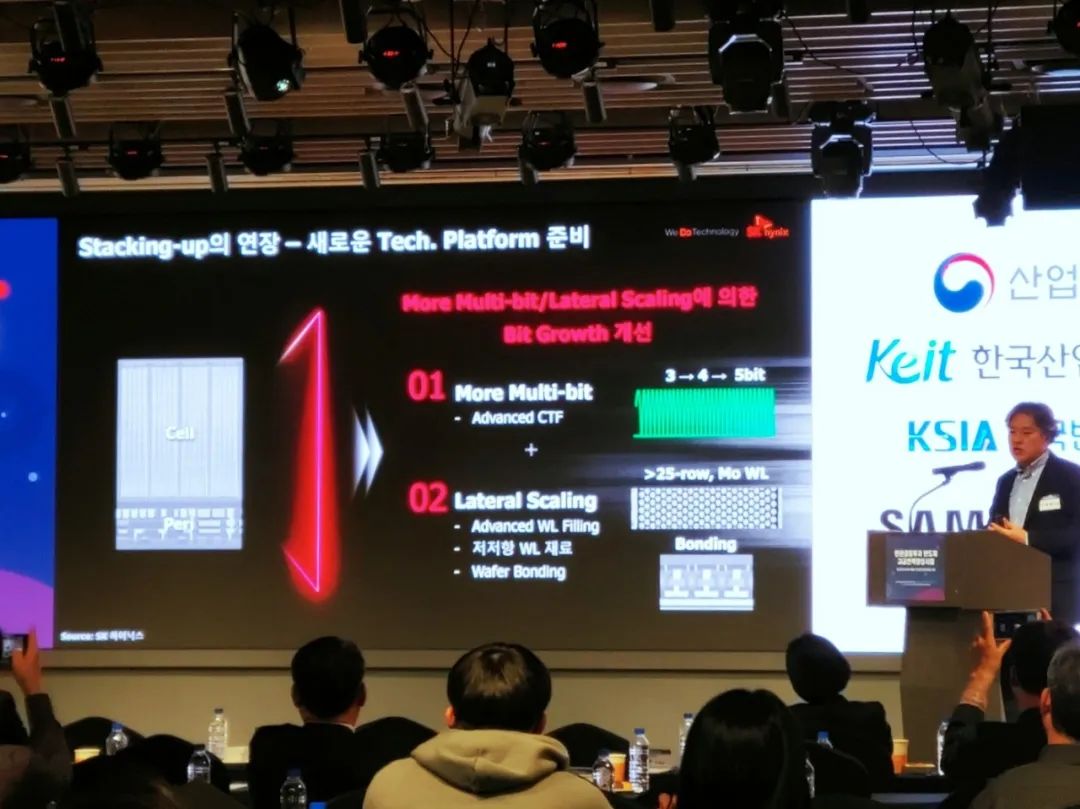

▲ SK海力士副总裁Lee Seong-hoon在半导体发展战略论坛上发表演讲

SK海力士未来技术研究院副院长Lee Seong-hoon在上届半导体发展战略论坛上表示:“如果GPT4真正实现商业化,预计数据处理速度和容量的提升将是巨大的。”

在ChatGPT-3.5以1750亿参数震惊世界后,即将推出的4.0版本据说参数量达到1万亿到100万亿,令业界和用户的期待值不断攀升。

半导体行业也在关注ChatGPT。通过5G和6G基础设施超高速无线传输海量数据,自动驾驶和车联网,以及基于ChatGPT的AI攻击,基本上都要求内存的超大规模,如大容量、高速等。

此外,将开发运营ChatGPT的各大搜索引擎供应商,如微软、谷歌、Naver等,必然会增加ESG趋势和对低功耗解决方案的需求,以降低能耗成本。

Seonghoon Lee副总裁表示,“内存的价值最终在于超大规模存储、高速、极度降低功耗的解决方案。有必要提高连接中的结电阻,”他补充道。

尽管由于今年上半年内存需求急剧下降,预计赤字将增加,但人们正在关注内存、服务器和 AI 处理处理器的需求是否会受到 ChatGPT 的成功推动。